Tämä on ehkä enemmänkin paluu hetkeksi vielä alkuun, motivaatiopuhe itselleni: Miksi tutkia tekoälyn riskejä? 😅

Kun Niko otti aiheen esille, ajattelin lähestyä sitä perinteisen riskianalyysin menetelmin. Tämä on varmaan tuttua monelle lukijalle, mutta käyn idean läpi:

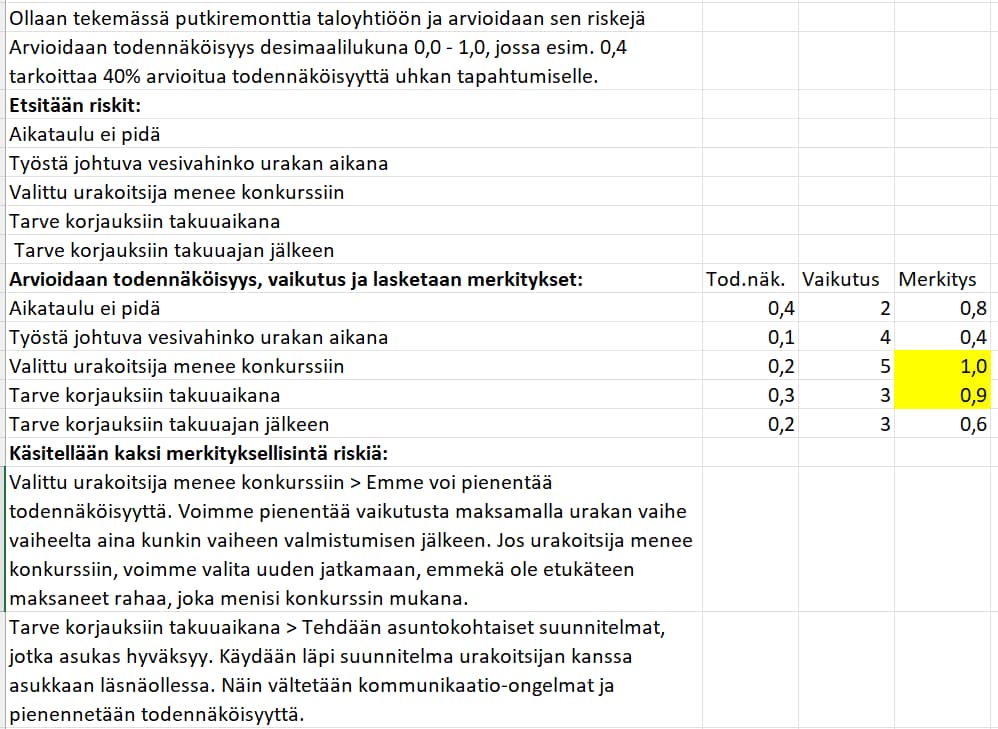

- Riskianalyysin perinteinen malli on tunnistaa mahdollisia uhkia hankkeelle tai projektille. Eri mahdollisuudet yritetään kaivaa esille. Sitten yritetään arvioida jokaisen uhkan osalta todennäköisyys sille, että uhka toteutuu + sen vaikutus = kuinka vakavat vaikutukset uhkan toteutumisella olisi.

- Jokaiselle uhkalle lasketaan merkitys = todennäköisyys x vaikutus. Sitten katsotaan esim. kaksi uhkaa, joilla on suurin merkitys. Nämä uhkaavat hanketta eniten. Kummankin osalta mietitään, onko olemassa joko pudottaa uhkan tapahtumisen todennäköisyyttä tai toisaalta pienentää vaikutusta, jos uhka todella tapahtuu.

- Alla on esimerkki

Mutta entä jos listalle lisätään AI-2027:n mukainen riski siitä, että takuuaikana tekoäly tuhoaa ihmiskunnan. Mitä ihmettä tämän tason tapahtumalle voisi antaa vaikutukseksi? 100? Vaikka sen todennäköisyys olisi vain 1%, nousisi se silloin listalla käsiteltäviin uhkiin. Ainakin pitäisi ymmärtää, onko tämä todellakin mahdollinen skenaario.

Siksi tätä läpikäyntiä teen.

Yhteenveto matkakertomuksen osista löytyy tästä ja muut osat tähän mennessä ovat:

- Osa 1: Kokemukseni tekoälystä tähän mennessä

- Osa 2: Kielimallin kouluttaminen

- Osa 4: Mikä on OpenClaw, joka teki oman Facebookin

- Osa 5: Tekoälyn vastuullinen hyödyntäminen

- Osa 6: Romahduttaako tekoäly SaaS-hinnoittelun

- Osa 7: Rauhoittuuko tekoälyn kehitysvauhti

Kerään linkit näihin blogikirjoituksiini sivulle “Mitä tekoäly on“.

0 Comments